欧盟人工智能合规责任制度改革及合规建议

2024-10-21

一���、前言

2024年5月21日���,欧盟理事会(Council of the European Union)批准通过欧盟《人工智能法》(Regulation (EU) 2024/1689, Artificial Intelligence (“AI”) Act)(下称“《欧盟AI法》”“《欧盟人工智能法》”或“EU AI Act”)。该法作为全球最具影响力的也是全球首部综合性人工智能(以下或称“AI”)规则���,已于2024年8月1日后正式生效。后续该法的相关条文将于未来5至6年分批次正式发生效力。

与之对应的是���,违反《欧盟人工智能法》所产生的法律后果为何?《欧盟人工智能法》作为监管规则���,仅规定有成员国行政罚款以及其他行政处罚责任。然而���,违反《欧盟人工智能法》合规义务所触发的法律责任却并不止于此。

2022年9月���,由欧洲委员会(European Commission)提议���,修订《产品质量责任指令》(Product Liability Directive)���,并制定《人工智能责任指令》(Artificial Intelligence Liability Directive)���,通过引致条款���,将潜在性地使得违反《欧盟人工智能法》合规义务法律责任扩展至民事赔偿责任���,从而因应新兴数字技术���,全方位地赋予《欧盟人工智能法》可执行性。

本所发布的《<欧盟人工智能法>的体系性解读及全景式合规建议》已全景式地梳理了适用范围���、合规风险点方面���,本文将接续前文���,详尽梳理并解读欧盟目前正在进行的人工智能责任体系改革的前因后果���,先导性地从违法效果的角度���,为中国企业提供法律责任视角下的合规指引。

二���、传统产品责任制度及其局限

(一)欧盟传统产品责任体系

欧盟制度中最近一次产品质量责任的现代化体现在1985年《欧盟理事会关于成员国有关缺陷产品责任的法律���、法规和行政规定问题第85/374/EEC指令》[1](下称“《1985年欧盟产品责任指令》”或“PLD 1985”)。《欧盟产品责任指令》与全球主流司法辖区产品责任规则相近���,对缺陷产品造成的损害责任认定采无过错责任原则���,因而受害人仅须主张并证明(1)产品具有缺陷;(2)遭受损害;(3)损害与产品缺陷之间存在因果关系。

PLD 1985作为指令的法源形式���,意味着成员国有义务将其中的规定转化为成员国国内立法���,而不能直接适用调整成员国境内的侵权责任关系。同时���,不同成员国国内法亦允许受害者通过疏忽的过错侵权责任制度或者违反瑕疵担保之契约责任向产品生产者和销售者索赔���,只要受害者可以证明各项责任要件事实成立即可。

然而���,上个世纪的产品责任制度现代化在数字技术高速普及和进化的今天再显疲态���,尤其是数字技术产品的无形性���、对数据的高度依赖性���、技术复杂性和互联性���,这都对PLD 1985责任规则的适用带来了全新的挑战。这种挑战在人工智能技术广泛普及和升级的时下社会���,不可避免地新生了通过旧有民事责任制度无法全面救济受害人的隐忧。

(二)人工智能技术向产品责任施加的重塑力

人工智能系统的构建基于通过机器学习人为输入或机器自主检索/生成输入的数据输出内容的人工智能模型���,表现出自主性���、对于环境的适应性���、有限的可预测性和不透明性���,受害人因此难以证明人工智能系统本身作为产品而具有缺陷���,更加难以证明其遭受的损害与该等缺陷存在法律上的因果关系。这类问题尤其是当集成到AI系统的模型具备显著通用性(significant generality)的时候���,相关损害将更具系统性和普遍性。

上述挑战使得不同欧盟成员国的法院不得不对相关人工智能发生的索赔适用区别于PLD 1985且具有特定成员国特色的法律规则及/或证据规则���,不仅有损于欧盟成员国规则的一致性���,同时企业也将面临着极大的司法不确定性;相应地���,这不仅增加了消费者对人工智能技术的不信任感���,更加挫伤了人工智能科学技术的创新和相关投资的增长。

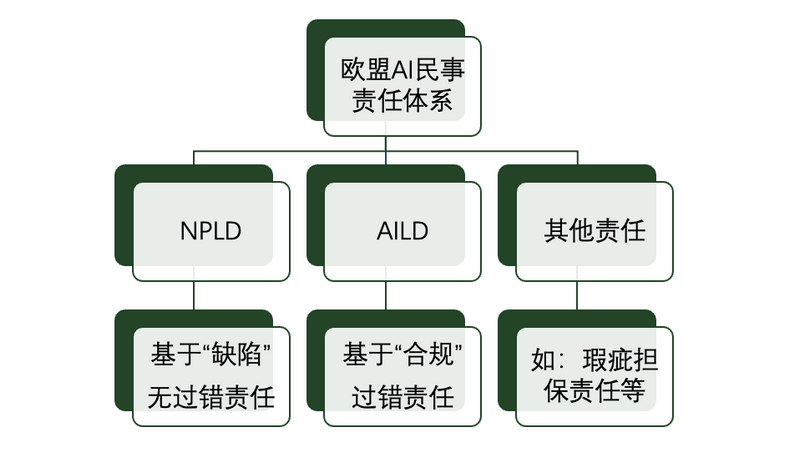

三���、欧盟人工智能“三重责任”体系

鉴于人工智能的广泛应用将不可避免地引入上述负外部效应���,在《欧盟人工智能法》审议立法的同时���,欧洲委员会特别向欧盟理事会和欧洲议会提议修改PLD(欧盟官方简称为“New Product Liability Directive”���,下称“《新欧盟产品责任指令》”或“NPLD”)���,并特别另行提议制定《人工智能责任指令》(Artificial Intelligence Liability Directive���,下称“《AI责任指令》”或“AILD”)���,以因应传统产品责任制度在数字技术时代所面临的挑战。NPLD与AILD两套责任体系与包括合同制度项下的瑕疵担保责任并行不悖。换言之���,存在产品缺陷的AI系统或嵌入其中的模型可能同时触发多重责任体系(至少三类)。

▲图1为欧盟正在酝酿的AI技术的“三重责任”体系

下文将主要对欧盟修订的NPLD以及新制定的AILD草案予以梳理和介绍���:

(一)NPLD体系

NPLD主要将从适用范围���、损害性质���、产品缺陷���、举证责任���、运营商抗辩等方面对PLD 1985进行修改。

1. 适用范围���:

NPLD同时修改了PLD 1985有关适用客体和主体的规定。

(1)适用客体���:

主要引入以下产品���:a. 包括嵌入式或独立式软件(包括软件更新)���,其中包括AI系统;b. 实现机械或工具的自动化控制文件(files)���,例如3D打印机;以及c. 就与之集成的产品组件发挥功能的产品而言是必须的数字服务���,例如自动驾驶汽车中的导航服务。

为了不妨碍技术创新���,NPLD的适用客体不包括���:a. 在商业活动之外开发或提供的开源软件;以及b. 软件的源代码。

(2)适用主体���:

NPLD修订了第7条有关“经济运营商(economic operators)”主体的类型���,使得以下AI利益相关方可能承担NPLD规定的产品责任���:a. 产品或部件的制造商(manufacturer of a product or component)���,同时任何在制造商控制范围之外对产品进行实质性修改(substantially modified)的经济运营商视同新的制造商也应对其实质性修改的产品或部件的任何缺陷负责;b. 相关服务的提供商(provider of a related service);c. 授权代表(authorised representative);d. 进口商(importer);f. 物流服务提供商或分销商(fulfilment service provider or the distributor);以及g. 网络平台(online platforms);

针对上述b至d项���,当AI系统及嵌入模型的制造商位于欧盟以外时���,NPLD将进一步将缺陷AI产品的责任归责于进口商和欧盟授权代表。作为最后的手段���,当进口商和欧盟授权代表位于欧盟以外时���,相关服务提供商(包括提供产品仓储���、包装���、寻址和调度服务)将承担产品质量责任。

2. 修订规则���:

NPLD仍然坚持产品质量责任制度项下的严格责任归责原则。

然而���,数字技术缺陷对他人造成损害具有隐蔽性���,受害人在索赔时难以收集证据支持其诉求因此成为了维权难题。相应地���,NPLD修订PLD 1985中的有关损害类型以及举证责任方面的规则。

(1)损害性质���:PLD 1985将损害性质限于死亡���、人身伤害或物质损失���,NPLD将扩展至以下性质���:a. 死亡或人身伤害���,包括医学上认可的心理伤害;b. 财产损失���,同时取消了500欧元的赔偿上限以及成员国设定7000万欧元赔偿上限;c. 非用于专业目的的数据丢失或损坏。

(2)缺陷(defects)以及缺陷推定制度���:因应数字技术特性���,将下述AI产品特性造成的危及人身���、他人财产安全的不合理的危险扩张定义为产品缺陷���:a. 制造商控制下的软件更新;b. 未能解决的网络安全漏洞;或者c. 机器学习。

同时���,NPLD在以下情况推定相关产品和服务存在缺陷���:a. 制造商未履行披露义务;b. 产品不符合强制性要求;或者

c. 损害系由于明显的产品故障造成。

(3)因果关系推定(presumption of causality)���:

受害人只需提供充足证据证明“索赔的合理性”(plausibility of the claim for compensation)���,即完成证明其损害以及缺陷���,NPLD在以下情况推定损害与缺陷之间构成法律上的因果关系���,除非运营商可以提出充足的反证���:a. 损害通常与所涉缺陷相符;或者b. 技术或科学的复杂性导致证明责任过于困难。

(4)运营商可以主张的抗辩���:a. 产品没有投入流通;b. 产品投入流通时���,引起损害的缺陷尚不存在的;或者c. 将产品投入流通时的科学技术水平尚不能发现缺陷的存在的。

(二)AILD体系

尽管《欧盟人工智能法》通过建立了“基于风险”的“双合规义务”体系���,在规则层面上应然地减少了AI系统的风险���,并禁止将对不可接受风险的AI系统投放市场。然而���,即使当符合《欧盟人工智能法》的AI系统在欧盟使用时���,出于技术特性或者人为原因���,仍然可能造成伤害。在此背景下���,AILD设立了过错责任制度���,与NPLD并行保护受害者的权益���,同时可以提供更强的法律预期性和确定性���,附带产生鼓励创新的效果。

1. 适用范围���:

AILD将通过引致条款���,将《欧盟人工智能法》相关定义甚至是适用主体和客体均作为AILD的适用范围���,从而压实了运营商严格遵守《欧盟人工智能法》的责任。

2. 主要制度���:

(1)过错原则���:与NPLD不同���,AILD为了防止重复赔偿并且实现运营商主动履行《欧盟人工智能法》合规义务的立法目的���,AILD仍然采过错责任归责原则���,即只有当运营商因为故意或者过失的过错而未履行《欧盟人工智能法》项下的合规义务并造成损害时���,受害人才可依AILD向运营商索赔。

(2)“侵权行为”���:结合AI技术的特性���,AILD规定的侵权行为比较特殊���,须满足以下两个方面���:a. 运营商未遵守欧盟或其成员国法律规定的注意义务(下称“不合规行为”);并且b. 人工智能系统产生了输出或者人工智能系统无法产生输出的结果(下称“AI系统的错误输出”)。

需要特别解释的是���,AI系统���,尤其是生成式AI系统���,根据给定的目标以及数据输出特定的结果���,这是AI系统的自身特性和功能所在。因此���,AI系统的错误输出本身并不会自身被认定为AILD项下的侵权行为���,只有在运营商不合规行为的影响下的AI系统的错误输出才有可能被认定为侵权行为。

(3)证据披露义务以及不合规行为推定���:AILD将赋予成员国法院要求高风险人工智能系统的相关运营商披露其合规证据的权力���,如果运营商在此情况下未予披露���,则推定其存在不合规行为���,因而在此情况下AI系统的错误输出将自动被视为AILD项下的“侵权行为”。

(4)因果关系推定���:在受害人依上述规则可以证明上述“侵权行为”���、损害���、过错时���,AILD推定该法项下的“侵权行为”与损害因果成立法律上的因果关系。

四���、欧盟下一步行动以及合规建议

NPLD和AILD在立法目标上更加倾斜地保护了在“黑匣”AI技术面前处于不利地位的用户和消费者���,通过建立各项制度增进消费者福利���,并将保障运营商的合规经营和公平竞争。即便如此���,欧盟内部的行业代表以及学者也提示两项法案将同样可能产生对数字技术创新发展的寒蝉效应���,应当对上述规则制度具体落实的细节进行更加细致的研讨和限定���,以尽力避免产生相应的负面效果。

从NPLD和AILD两项立法目前展现的细节可以看出���,欧盟AI技术的民事赔偿责任制度已经箭在弦上���,出海欧洲的中国企业应当尽早开展《欧盟人工智能法》合规项目落地���,并对欧盟人工智能民事责任制度改革予以适当持续关注���,确保合规经营���,做好经营过程的证据收集工作���,以避免产生潜在索赔争议。

注释���:

[1]英文名称为Council Directive 85/374/EEC on the approximation of the laws, regulations and administrative provisions of the Member States concerning liability for defective products, a.k.a. Product Liability Directive。

本文作者���:

指导合伙人���:

声明���:

本文由k8凯发天生赢家·一触即发律师事务所律师原创���,仅代表作者本人观点���,不得视为k8凯发天生赢家·一触即发律师事务所或其律师出具的正式法律意见或建议。如需转载或引用本文的任何内容���,请注明出处。